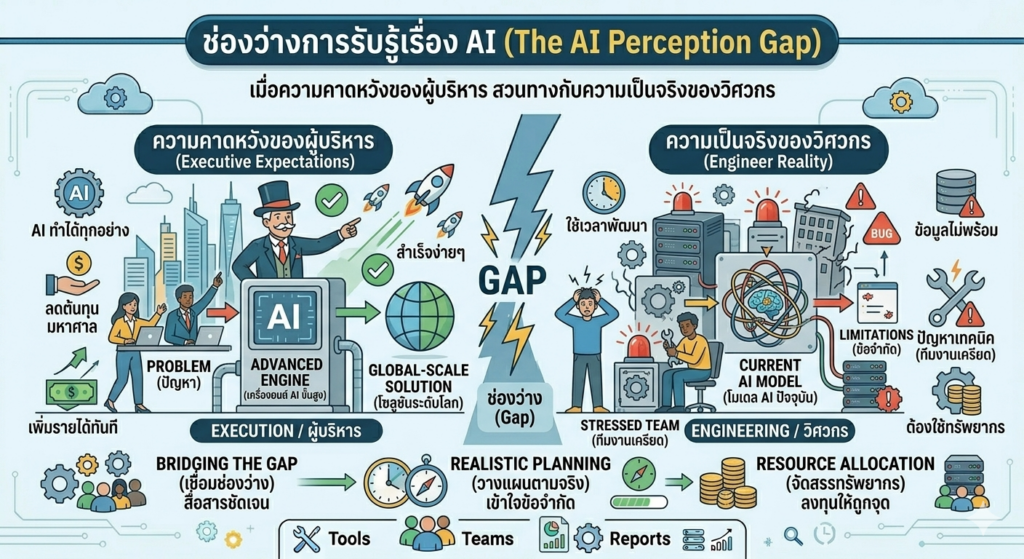

ช่องว่างการรับรู้เรื่อง AI (The AI Perception Gap)

เมื่อความคาดหวังของผู้บริหาร สวนทางกับความเป็นจริงของวิศวกร

บทสรุปผู้บริหาร

“AI Perception Gap” ไม่ใช่เพียงแค่ความต่างของความเชื่อมั่น แต่มันคือความเข้าใจที่คลาดเคลื่อนเกี่ยวกับ หน่วยวัดคุณค่า (Unit of Value) ของการพัฒนาซอฟต์แวร์

ในขณะที่ผู้บริหารมอง AI ผ่านมุมมองของ ความเร็ว (Velocity) แต่เหล่านักพัฒนา (ICs) กลับต้องเผชิญกับ ภาระทางพุทธิปัญญา (Cognitive Load) ที่เพิ่มขึ้นจากการตรวจสอบและดูแลรักษา

หากไม่ได้รับการแก้ไข ช่องว่างนี้จะสร้าง “หนี้ทางเทคนิคแฝง (Ghost Technical Debt)” ที่จะฉุดรั้งโครงสร้างระบบของคุณภายใน 18–24 เดือน

1. จาก “10x Coder” สู่ “10x Reviewer”

ผู้บริหารมักคิดว่าเมื่อการเขียนโค้ดเพิ่มขึ้น 40% การส่งมอบฟีเจอร์ต้องเพิ่มขึ้น 40% ตามไปด้วย

🔍 ความเป็นจริงทางเทคนิค

LLMs ย้ายคอขวดจากการ สังเคราะห์โค้ด (Synthesis) ไปสู่การ ตรวจสอบ (Verification) แม้ IC จะสร้างคอมโพเนนต์ได้ในไม่กี่วินาที แต่เวลาที่ใช้ตรวจสอบ Edge Cases, ช่องโหว่ความปลอดภัย (เช่น XSS) และความสอดคล้องกับสถาปัตยกรรมยังคงเท่าเดิมหรือนานกว่าเดิม

🔹 ช่องว่างที่เกิดขึ้น

ผู้บริหารวัด “Lines of Code (LOC)” แต่ IC กำลังจมกองโค้ดในขั้นตอน “PR Review”

🔹 กลยุทธ์ผู้นำ

เปลี่ยน KPI จาก Velocity เป็น Cycle Time หาก PR ค้างนานขึ้นเพราะโค้ดมีขนาดใหญ่ขึ้น 5 เท่าจากการใช้ AI แสดงว่าประสิทธิภาพนั้นเป็นเพียงภาพลวงตา ควรนำเครื่องมือประเภท Automated Reasoning (เช่น Graphite, Codium) มาช่วยในกระบวนการ Review แทนที่จะใช้ AI แค่ตอนเขียน

2. ป้องกันสถาปัตยกรรมเสื่อมสภาพ (Stochastic Spaghetti)

แรงกดดันแบบ “AI-first” มักทำให้ IC ใช้ Code Pattern ที่ AI แนะนำ ซึ่งอาจไม่สอดคล้องกับบริบทภายในของระบบ Microservices เดิม

🔍 ความเป็นจริงทางเทคนิค

LLM มักเสนอโค้ดที่ “มีความเป็นไปได้สูงสุด” ซึ่งมักเป็นโค้ดมาตรฐาน (Boilerplate) ทั่วไป ทำให้เกิด Consistency Drift (ความสม่ำเสมอของโค้ดลดลง)

🔹 แนวทางแก้ไข

เลิกใช้แค่ Chatbot ทั่วไป แต่ให้ใช้ RAG-enhanced IDEs (เช่น Cursor, Sourcegraph Cody) ที่มีการทำ Indexing ร่วมกับ Private Repository และ ADR (Architecture Decision Records) ของบริษัท

🔹 ผลลัพธ์ที่ต้องการ

เพื่อให้แน่ใจว่า AI จะแนะนำ Pattern ตาม “Golden Path” ขององค์กร ไม่ใช่แค่โค้ดทั่วไปจาก StackOverflow

3. วิกฤตการขาดความรู้เชิงลึกในกลุ่ม Senior (Juniorization)

จุดบอดที่สำคัญคือการที่ Senior Engineers สูญเสียแผนที่ความคิด (Mental Map) ของระบบไปเนื่องจากพึ่งพา AI ในการ Debug มากเกินไป

🔍 ความเป็นจริงทางเทคนิค

AI ขาดบริบทของ Runtime ในระบบ Distributed System จริงๆ เมื่อเกิดเหตุการณ์ P0 (ระบบล่มรุนแรง) “ไม้ค้ำ AI” จะช่วยอะไรไม่ได้เลยหากคนขาดความเข้าใจในระบบอย่างถ่องแท้

🔹 กลยุทธ์ผู้นำ

- กำหนด “AI-Free Zones” สำหรับส่วนประกอบหลักของสถาปัตยกรรม (Core Architecture)

- สนับสนุน “AI-Driven TDD”: ให้คนเป็นผู้เขียน Test (กำหนดเจตจำนง) และให้ AI เป็นผู้เขียน Implementation (ไวยากรณ์โค้ด) เพื่อให้คนยังคงเป็น “สถาปนิก” ของระบบ

4. LLMOps: โครงสร้างพื้นฐานที่มากกว่าแค่แชทบอท

การซื้อ License ChatGPT ให้พนักงานไม่ใช่กลยุทธ์ AI ที่ยั่งยืน ผู้นำต้องมองแบบ DevOps for AI

🔹 Context Management

ใช้เครื่องมืออย่าง Bloop.ai เพื่อทำ Semantic Search ทั่วทั้ง Codebase

🔹 Security & Compliance

ใช้ Snyk หรือ Prisma Cloud ตรวจสอบช่องโหว่โดยอัตโนมัติ เพราะ AI มักเขียนโค้ดที่เสี่ยงกว่าคน

🔹 Observability

ใช้ Honeycomb หรือ Datadog เพื่อตรวจจับความผิดปกติที่ AI อาจแอบทิ้งไว้ในการ Deploy ที่ถี่ขึ้น

5. ตัวชี้วัดที่สำคัญและ ROI (มุมมอง PM)

เลิกวัด “เปอร์เซ็นต์โค้ดที่เขียนโดย AI” เพราะมันคือ Vanity Metric เพื่อรักษา ต้นทุนรวมในการเป็นเจ้าของ (TCO) ให้วัดผลดังนี้:

วัดผลที่แท้จริง

- Change Failure Rate (CFR): โค้ดที่ AI เขียนทำให้เกิดการ Rollback บ่อยขึ้นหรือไม่?

- Documentation-to-Code Ratio: เพื่อให้แน่ใจว่าเหตุผลเบื้องหลัง (The Why) ไม่ได้หายไป

- Refactor Frequency: หากต้อง Refactor โค้ดที่ AI เขียนบ่อยเกินไป แสดงว่า Context หรือทักษะการ Prompt ของทีมมีปัญหา

แผนการดำเนินงาน (Implementation Blueprint)

3 ขั้นตอนที่ต้องทำทันที

- Standardize Prompt Libraries: สร้างคลัง “Golden Prompts” สำหรับ Stack ของทีมโดยเฉพาะ

- The 20% Debt Rule: แบ่ง 20% ของเวลาที่ประหยัดได้จาก AI กลับไปใช้ในการจัดการ Technical Debt เดิม

- Traceability Audits: ปรับ Definition of Done (DoD) ให้รวมการตรวจสอบว่าโค้ด AI สามารถไล่กลับไปยังความต้องการทางธุรกิจ (PRD) ได้จริงโดยไม่มีตรรกะที่ AI มโนขึ้น (Hallucination)

บทสรุปสำหรับผู้บริหาร

AI ไม่ได้ลดความต้องการวิศวกร แต่กำลังเพิ่มความต้องการ สถาปนิกระบบ (System Architects)

เรากำลังเปลี่ยนจากการเป็น “คนเขียนโค้ด” ไปเป็น “ผู้ดูแลระบบ”

ROI ที่แท้จริงไม่ได้อยู่ที่การสร้างโค้ด แต่อยู่ที่

👉 โครงสร้างพื้นฐานที่สนับสนุนการตรวจสอบและบริบทของระบบสืบไป